A Inteligência Artificial (IA) tem feito progressos incríveis nos últimos anos. No entanto, compreender o que é uma alucinação de IA e como superá-la ainda é um processo contínuo para os criadores de LLM.

A tecnologia de hoje e de amanhã continua a fascinar-nos a todos, especialmente quando se trata de como a IA pode compreender e gerar a linguagem humana. Grandes saltos foram dados com Large Language Models (LLMs), programas de computador treinados em grandes quantidades de texto. Esses LLMs podem escrever diferentes tipos de formatos de texto criativos, como poemas, códigos, roteiros, peças musicais, e-mail, cartas, etc.

No entanto, há um problema peculiar que surge com o poder destes modelos impressionantes – eles às vezes “alucinam”.

O que é uma alucinação de IA?

Assim como os humanos podem imaginar ou sonhar coisas que não são reais, a IA pode fazer algo semelhante. As alucinações de IA acontecem quando um LLM produz um texto que parece verossímil, mas é factualmente errado. Essas alucinações podem variar de pequenos erros a histórias completamente inventadas e declarações sem sentido.

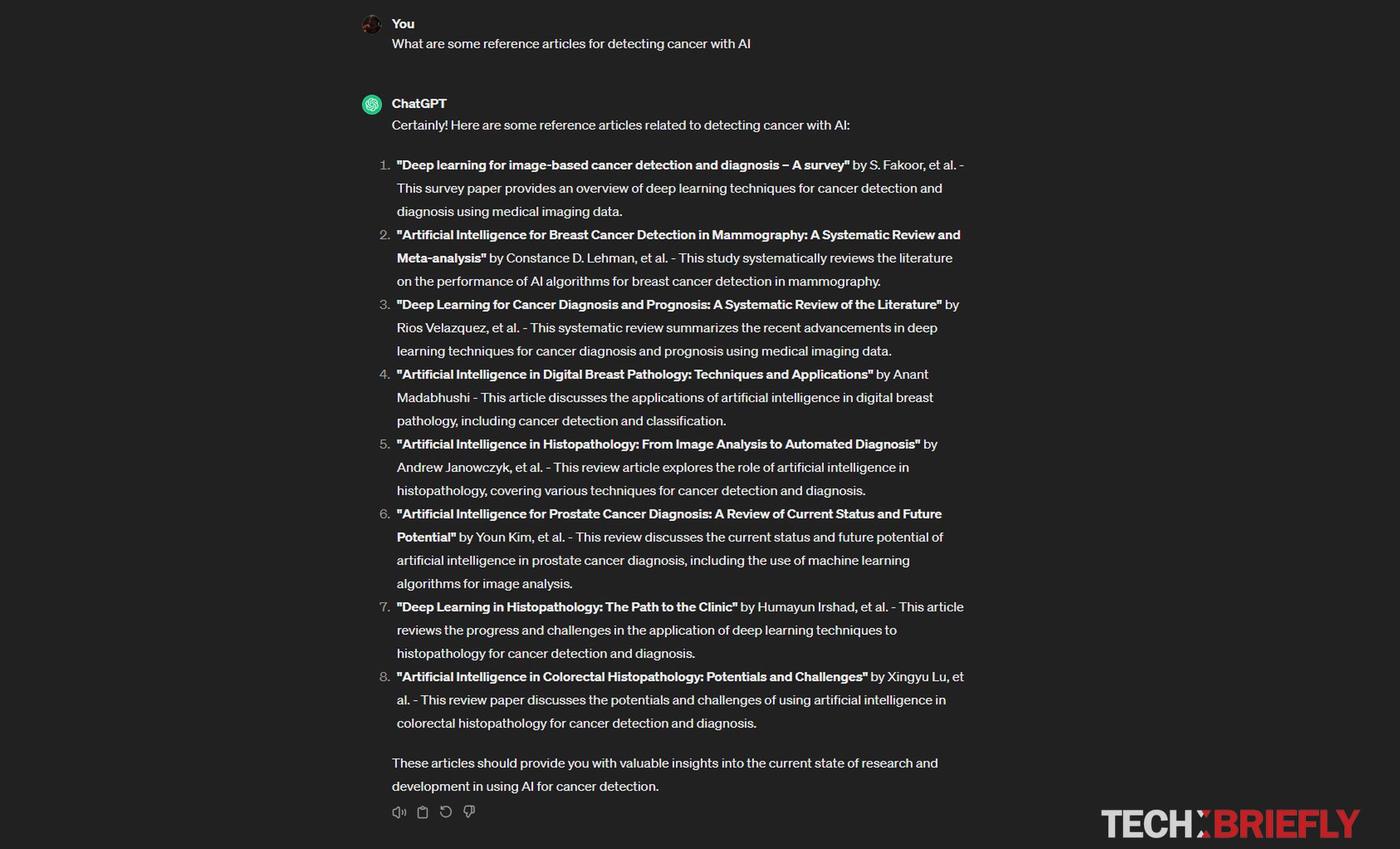

Para entender melhor esse problema, vejamos alguns exemplos:

- Misturando fatos: uma IA solicitada a escrever um artigo de notícias sobre um evento pode incluir datas e locais incorretos ou deturpar as pessoas envolvidas.

- Criando falso informação: uma IA encarregada de escrever uma descrição de produto poderia inventar recursos que o produto realmente não possui.

- Confiantemente incorreto: O que é realmente complicado sobre as alucinações de IA é que elas geralmente são apresentadas de uma maneira muito convincente, tornando difícil diferenciá-las de informações reais.

Por que as alucinações são um problema para os LLMs?

Como você pode ver em nossas explicações sobre o que é uma alucinação de IA, elas são um problema significativo para os LLMs por vários motivos. Primeiro, se as pessoas não puderem confiar no texto gerado por um LLM, os usuários perderão a fé na utilidade geral e na confiabilidade da tecnologia. Imagine que você está lendo um resumo online de uma notícia escrita por um LLM. Se o resumo contiver erros factuais, você poderá parar de usar essa fonte completamente. Isso pode ser um grande problema para qualquer aplicação que dependa de LLMs para gerar texto, como chatbots, assistentes virtuais ou ferramentas automatizadas de criação de conteúdo.

Em segundo lugar, as alucinações da IA podem contribuir para a propagação de desinformação. Numa época em que as notícias falsas já são uma grande preocupação, o texto gerado pela IA que parece credível pode facilmente ser confundido com informação real. Isto poderia ter um impacto negativo em tudo, desde o discurso público até importantes processos de tomada de decisão. Por exemplo, imagine um LLM criando postagens nas redes sociais sobre um candidato político que contém informações falsas.

Essas postagens podem enganar os eleitores e influenciar o resultado de uma eleição. Essa é exatamente a razão pela qual o Google desativou a capacidade do Gemini de responder a perguntas relacionadas às eleições.

Terceiro, as empresas ou organizações que utilizam LLMs podem enfrentar danos à reputação se os seus sistemas de IA produzirem conteúdo impreciso ou prejudicial. Digamos que uma empresa use um LLM para escrever descrições de produtos para sua loja online. Se o LLM inventar recursos que os produtos realmente não possuem, isso poderá levar à insatisfação do cliente e prejudicar a reputação da empresa.

Por que acontecem as alucinações de IA?

Você tem algumas ideias sobre o que é uma alucinação de IA agora, mas por que elas acontecem? Vários fatores estão contribuindo para esse problema:

- Como eles são treinados: LLMs são alimentados com enormes quantidades de dados de texto. Esses dados geralmente contêm erros, preconceitos e informações desatualizadas. A IA aprende com esses dados da mesma forma que com informações corretas.

- Compreender vs criar: LLMs são bons na compreensão de padrões de linguagem, mas nem sempre têm uma compreensão sólida de conceitos ou lógica do mundo real. Eles podem gerar algo que parece plausível sem que seja realmente verdade.

- A busca pela fluência: LLMs são projetados para produzir texto que soe natural e humano. Às vezes, isso significa “preencher as lacunas” onde pode haver lacunas no conhecimento da IA. Esses espaços preenchidos podem levar a IA a criar conteúdo.

O que está sendo feito para resolver isso?

Pesquisadores e desenvolvedores da comunidade de IA estão trabalhando ativamente em maneiras de reduzir as alucinações de IA.

Algumas das abordagens incluem:

- Melhores dados de treinamento: Criação de conjuntos de dados cuidadosamente selecionados com menor probabilidade de conter erros e preconceitos, levando a um melhor comportamento da IA.

- Verificando os fatos: Desenvolver técnicas para cruzar textos gerados por IA com fontes confiáveis, garantindo sua precisão.

- Explicabilidade: Projetar LLMs que possam explicar seu processo de raciocínio, o que torna mais fácil detectar possíveis erros

- Colaboração humano-IA: Construir sistemas onde humanos e IA trabalhem juntos, facilitando a identificação e correção de alucinações.

Além de tudo isso, Jensen Huang da Nvidia afirma que as alucinações de IA podem ser curadas nos próximos 5 anos.

Portanto, as alucinações de IA são um desafio complexo, mas é crucial superá-lo se os LLMs quiserem atingir todo o seu potencial. À medida que as tecnologias para reduzir as alucinações se tornam mais sofisticadas, elas prometem tornar os LLMs uma ferramenta muito mais confiável e valiosa para tarefas de comunicação, criatividade e conhecimento.

Crédito da imagem em destaque: vackground.com/Remover respingo

Source: O que é uma alucinação de IA e por que é um grande problema para o futuro dos LLMs?